Fließen Ihre industriellen Daten zuverlässig, vollständig und in der richtigen Qualität? In der Praxis zeigt sich: Ein Unified Namespace (UNS) schafft zwar die Infrastruktur für einen zentralen Datenstrom, doch ohne eine klare operative Disziplin und Governance bleibt der UNS ein unkontrollierter Datenkanal. Genau hier setzt Industrial DataOps an. Dieser Artikel erklärt, was Industrial DataOps bedeutet, welche Rolle es im UNS spielt und mit welchen konkreten Schritten der Einstieg in die Praxis gelingt.

Was ist Industrial DataOps?

Industrial DataOps ist eine kollaborative Aufgabe zur kontinuierlichen Verwaltung industrieller Datenpipelines – von der Erfassung an der Maschine bis zur Nutzung in Analytics, MES (Manufacturing Execution System) oder ERP-Systemen (Enterprise Resource Planning). Der Begriff überträgt die Prinzipien von DevOps – Automatisierung, Qualitätssicherung, kollaborative Verantwortung – auf die Welt der Fabrikdaten.

| DataOps-Prinzip | Bedeutung im industriellen Kontext |

|---|---|

| Automatisierung | Datenpipelines ohne manuelle Eingriffe betreiben |

| Qualitätssicherung | Validierung und Plausibilitätsprüfung jedes Datenpunkts |

| Observability | Sichtbarkeit über Datenstatus, Latenz und Ausfälle |

| Kollaboration | OT- und IT-Teams teilen Verantwortung für Datenflüsse |

| Iteration | Pipelines kontinuierlich verbessern statt einmalig einrichten |

Wichtig: Industrial DataOps ist keine Softwarekomponente, die man installiert. Es handelt sich vielmehr um eine operative Disziplin, die definiert, wie Teams mit industriellen Daten umgehen – technisch wie organisatorisch.

Die Rolle von Industrial DataOps im Unified Namespace

Der UNS bildet die Infrastruktur für einen zentralen, hierarchischen Datenstrom. Alle Systeme – von der SPS (Speicherprogrammierbare Steuerung) bis zum ERP – veröffentlichen und konsumieren Daten über einen gemeinsamen Message Broker, beispielsweise NATS oder MQTT. Damit entfallen Punkt-zu-Punkt-Verbindungen zwischen Einzelsystemen, und alle Daten stehen als Single Source of Truth (SSOT) bereit.

Doch der UNS beantwortet allein noch nicht die entscheidende Frage: Sind diese Daten korrekt, vollständig und konsistent? Ein Sensor kann fehlerhafte Werte liefern. Eine SPS kann Verbindungen unterbrechen. Ein Datenformat kann sich ändern, ohne dass Consumer informiert werden. Industrial DataOps füllt genau diese Lücke: Es definiert, wie Daten im UNS gepflegt, validiert und zuverlässig bereitgestellt werden.

Das Verhältnis lässt sich klar beschreiben:

- Unified Namespace: Infrastruktur – der Datenkanal

- Industrial DataOps: operative Disziplin – die Qualitätssicherung des Datenkanals

Beide Ebenen ergänzen sich. Daher ist ein UNS ohne DataOps-Praxis technisch funktionsfähig, aber operativ fragil und nicht skalierbar.

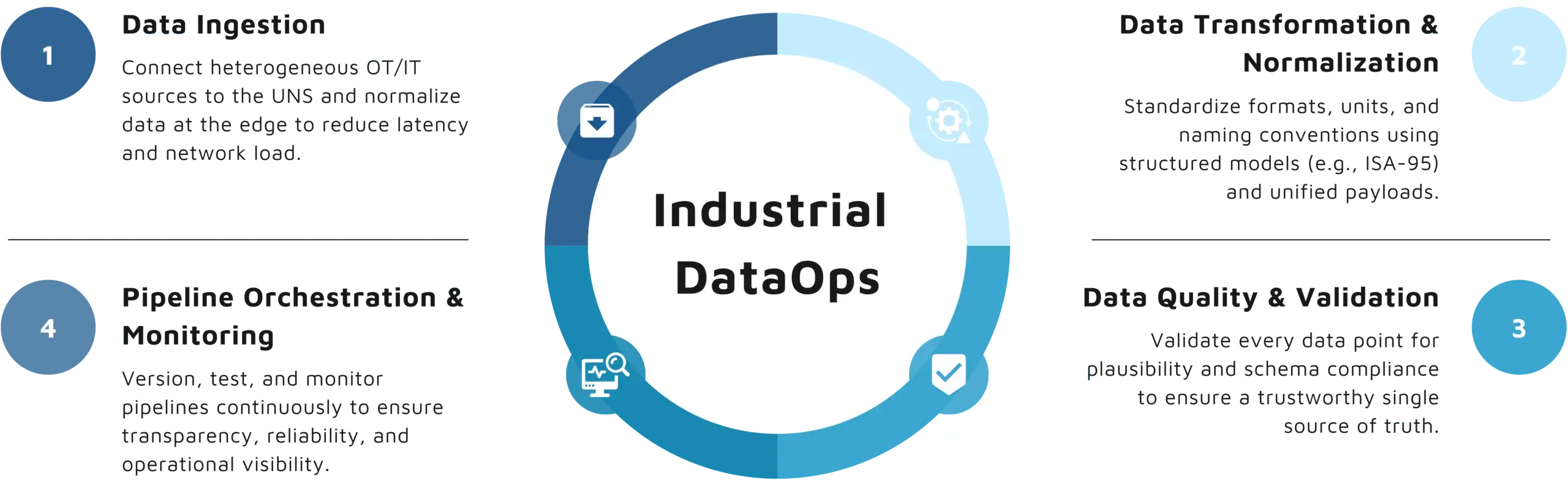

Die wichtigsten Aufgabenbereiche im Überblick

Industrial DataOps im UNS umfasst vier zentrale Aufgabenbereiche, die zusammen eine zuverlässige Datenbasis aufbauen:

1. Datenerfassung und Ingestion

Industrielle Daten kommen aus heterogenen Quellen: SPSen, SCADA-Systemen (Supervisory Control and Data Acquisition), Sensoren sowie übergelagerten Systemen wie MES oder SAP. Die Ingestion-Schicht verbindet diese Quellen mit dem UNS und normalisiert bereits die Rohdaten beim Eingang. Entscheidend ist dabei die Nähe zur Quelle: Vorverarbeitung direkt an der Maschine reduziert unnötigen Netzwerkverkehr und erhöht die Reaktionsfähigkeit des Gesamtsystems.

2. Datentransformation und Normalisierung

Rohdaten verschiedener Quellen sind selten direkt kompatibel. Data Engineers müssen Formate, Einheiten und Namenskonventionen vereinheitlichen, bevor Consumer damit arbeiten können. Im UNS geschieht dies über standardisierte Datenmodelle – typischerweise auf Basis der ISA-95-Hierarchie (Enterprise / Site / Area / Line / Cell) und einheitlichen Payload-Formaten wie JSON.

3. Datenqualität und Validierung

Jeder Datenpunkt sollte bei der Ingestion aktiv validiert werden: Liegt der Wert im plausiblen Bereich? Stimmt das erwartete Schema? Handelt es sich um einen Ausreißer oder einen echten Messwert? Fehlerhafte Datensätze werden isoliert und gemeldet – nicht still ignoriert. Nur so können Consumer dem UNS als SSOT dauerhaft vertrauen.

4. Pipeline-Orchestrierung und Monitoring

Datenpipelines sollten wie Software behandelt werden: versioniert, getestet und kontinuierlich überwacht. Observability – die Fähigkeit, den Zustand einer Pipeline von außen zu beurteilen – ist dabei das zentrale Instrument. Wann kamen welche Daten zuletzt an? Welche Topics sind seit Stunden stumm? Was fehlt? Ohne Monitoring bleibt auch ein gut aufgebauter UNS eine operative Blackbox.

Getting Started: Fünf Schritte zum Industrial DataOps Einstieg

Der praktische Einstieg in Industrial DataOps gelingt am besten iterativ. Diese fünf Schritte schaffen eine solide Grundlage:

- Datenquellen und Consumer kartieren: Welche Systeme publizieren Daten in den UNS? Welche Systeme konsumieren sie? Außerdem: Welche Datenpunkte sind geschäftskritisch? Diese Karte bildet die Grundlage für alle weiteren Entscheidungen.

- Topic-Struktur und Datenmodell definieren: Auf Basis der ISA-95-Hierarchie eine einheitliche Topic-Struktur festlegen. Beispiel:

werk01/assembly/line01/process01/temperature. Ein konsistentes Modell ist Voraussetzung für zuverlässige, wartbare Pipelines. - Validierungsregeln pro Datentyp definieren: Für jeden relevanten Datenpunkt festlegen, was ein gültiger Wertebereich ist und welches Schema erwartet wird. Diese Regeln werden direkt bei der Ingestion angewendet – bevor fehlerhafte Daten den UNS erreichen.

- Monitoring und Alerting einrichten: Fehlende oder fehlerhafte Nachrichten müssen sichtbar sein. Bereits ein einfaches Dashboard, das zeigt, welche Topics aktiv sind und welche schweigen, erhöht die Betriebssicherheit erheblich.

- Iterativ erweitern: Industrial DataOps ist kein Einmalprojekt. Pipelines werden kontinuierlich verbessert: neue Quellen werden angebunden, Validierungsregeln verfeinert und das Monitoring schrittweise ausgebaut.

i-flow als Industrial DataOps Plattform im UNS

i-flow bietet eine durchgängige Plattform für Industrial DataOps im UNS. Die Architektur folgt einem klaren Prinzip: Konfiguration zentral im i-flow Hub erstellen – Ausführung dezentral über i-flow Edges nah an der Quelle.

- Der i-flow Hub dient als zentrale Verwaltungsinstanz. Dort werden Datenmodelle, Transformationsregeln, Validierungslogik und Verbindungskonfigurationen definiert. Änderungen lassen sich konsistent auf alle Edge-Instanzen ausrollen – ohne manuelle Eingriffe vor Ort.

- Die i-flow Edge führt diese Konfigurationen direkt an der Quelle aus. Sie verbindet sich mit SPSen, SCADA-Systemen und Sensoren über native Protokolle wie OPC UA, Modbus oder Siemens S7, transformiert die Daten lokal und publiziert sie normalisiert in den UNS. Dadurch bleibt die Verarbeitung nah am Entstehungsort. Wichtig für offline Szenarien oder Szenarien, in denen minimale Latenz ohne unnötigen Datenverkehr in Richtung Cloud oder Rechenzentrum essentiell sind.

- Der i-flow Broker stellt den zentralen Message Broker des UNS bereit – auf Basis von NATS und MQTT – und sorgt für die zuverlässige Zustellung aller Datenpunkte zwischen Producern und Consumern. Dieses Zusammenspiel aus Hub, Edge und Broker bildet das technische Fundament für einen produktionsreifen DataOps-Betrieb.

Fazit

Industrial DataOps macht den Unified Namespace erst skalierbar. Der UNS schafft die Infrastruktur für einen zentralen Datenstrom – die DataOps-Praxis definiert, wie dieser Datenstrom zuverlässig, qualitätsgesichert und kontinuierlich betrieben wird. Ohne diese operative Disziplin bleibt auch ein gut konzipierter UNS ein ungepflegter Datenkanal, dem Consumer nicht uneingeschränkt vertrauen können. Der Einstieg gelingt iterativ: Quellen kartieren, Datenmodell definieren, Validierung einführen, Monitoring aufbauen und schrittweise erweitern. Mit i-flow lassen sich diese Schritte durchgängig umsetzen – von der zentralen Konfiguration im Hub bis zur dezentralen Ausführung direkt an der Datenquelle.